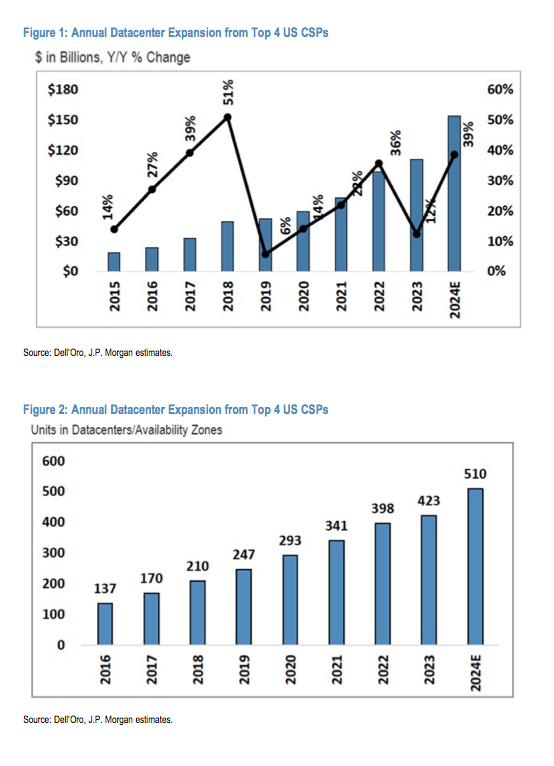

JP Morgan | Las previsiones actualizadas recientemente sobre el gasto en capex de los centros de datos en la nube sugieren una aceleración del entorno de gasto en capex para CY24 (véase la Figura 1) con un fuerte impulso en 2025 impulsado por el desarrollo de la infraestructura de IA, las actualizaciones de infraestructura y la fuerte construcción de centros de datos. En general, esto concuerda con los comentarios sobre el capex de la nube y el hiperescalador de la temporada de resultados del primer trimestre de 2014 y con las expectativas del mercado, y respalda nuestra opinión de un sólido ciclo de gasto plurianual en el desarrollo de la infraestructura de IA. De hecho, nuestro equipo de IT Hardware ha revisado positivamente su previsión de crecimiento del capex en la nube (para los 4 principales CSP de EE.UU.) para CY24 a +40% (frente al +14% anterior). La visión actualizada refleja un fuerte crecimiento secuencial de los 4 principales CSP estadounidenses. Igualmente importante es el hecho de que nuestro equipo de hardware informático espera un crecimiento continuado del 30% del capex de la nube para CY25, respaldado por sólidos planes de construcción de centros de datos, que es lo que se incluye en nuestras hipótesis de semiconductores para los nombres expuestos a la IA.

En términos absolutos, se espera que el gasto en centros de datos aumente en más de 40.000 millones de dólares en el año CY24, de los cuales ~70% corresponde a inversiones en servidores y conmutadores de IA (28.000 y 3.000 millones de dólares, respectivamente) y el resto está relacionado con servidores de uso general (+4.000 millones de dólares), conmutadores de uso general (+1.000 millones de dólares) y otros (10.000 millones de dólares). En general, nos anima la fortaleza generalizada del gasto en capex, ya que las empresas se centran en construir su infraestructura de IA. En cuanto a la IA y la computación acelerada, esto está impulsando una demanda masiva de las soluciones de GPU de Nvidia (que también está impulsando una fuerte demanda de sus soluciones de red InfiniBand) y proporciona un sólido perfil de demanda para varios trimestres para el equipo, combinado con su rampa de productos Blackwell de nueva generación a partir del cuarto trimestre. AMD también se beneficia de la fuerte demanda de su GPU para centros de datos MI300, que el equipo espera que genere unos ingresos de más de 4.000 millones de dólares en 2024 y un mejor entorno general de gasto en servidores.

También creemos que Arm es un beneficiario clave en el mercado de los centros de datos, ya que la integración de CPU/GPU es un área clave para desbloquear más computación de IA en los clústeres de computación de próxima generación (por ejemplo, más hiperescaladores están anunciando sus soluciones de CPU basadas en Arm y el chipset GB200 de Nvidia). En cuanto a los ASIC personalizados, Marvell está poniendo en marcha sus dos primeros programas de ASIC de IA (Amazon, Google) en computación en el año CY24 (esperamos unos ingresos de más de 600 millones de dólares en ASIC personalizados), y en Broadcom creemos que el equipo debería generar unos ingresos de más de 8.000-9.000 millones de dólares en ASIC personalizados de IA en el año fiscal FY24 (TPU de Google, TPU de Meta MTIA). La fuerte demanda de computación de IA también está impulsando una fuerte demanda de redes de alto rendimiento y debería seguir impulsando una fuerte actividad de pedidos/diseño para los productos de red de Broadcom (conmutación/enrutamiento, conmutación PCIe, óptica), los conjuntos de chips DSP 800G/1,6T PAM4 de Marvell (por ejemplo, fuertes pedidos PAM4 de Nvidia/Google) y los conjuntos de chips de retimer Gen5/Gen 6 de Astera. La fuerte demanda de computación de IA también beneficiando a Micron/Western Digital en memoria/almacenamiento. Los nuevos despliegues de infraestructuras para centros de datos totalmente nuevos también son buenos para los proveedores de computación de propósito general (INTC y AMD) y de almacenamiento/memoria (MU y WDC). Los principales valores en IA/nube son OW AVGO, OW MRVL, OW MU, OW KLAC y OW SNPS.

Broadcom y Marvell se benefician de la fuerte demanda de chips de IA personalizados (ASIC) y soluciones de semiconductores ópticos para redes de IA de alto rendimiento – DSP óptico de 1,6T en rampa en la segunda mitad del año y hasta 2025… Astera Labs se beneficia de la fuerte conectividad servidor/red con su liderazgo en conectividad PCIe y su creciente línea de productos de red. Como se refleja en los beneficios del trimestre de abril, Broadcom sigue experimentando un fuerte tirón de la demanda de sus productos de IA (por ejemplo, el programa TPU ASIC de procesador de IA de Google, la rampa inicial del programa TPU ASIC de procesador de IA de Metal, los conjuntos de chips de conmutación/enrutamiento Tomahawk/Jericó y los conjuntos de chips de conmutación PCIe para NVIDIA). Creemos que Broadcom generará entre 11.000 y 12.000 millones de dólares en ingresos totales por IA este año (ASIC, redes, PCIe) y más de 15.000 millones el año que viene. En cuanto a Marvell, creemos que los programas/productos del equipo relacionados con la IA (ópticos/ASIC) están en vías de impulsar un sólido perfil de crecimiento en el año CY24 (aumento >3 veces interanual hasta 1.600-1.800 millones de dólares) y visibilidad de más de 3.000 millones de dólares en ingresos por IA en CY25. Las soluciones de red Infiniband/Ethernet también están pasando a SERDES de 200 Gbps/canal e impulsando la rampa inicial de la solución de chipset DSP óptico de 1,6 T de Marvell.

Aceleración de la inversión en centros de datos en el año CY24 con un fuerte crecimiento continuado en el año CY25; fortaleza del gasto de base amplia liderado por la IA. La expansión de más de 40.000 millones de dólares del gasto en centros de datos (+40% interanual) prevista para 2024 está impulsada por la expansión de la inversión en todo el centro de datos, incluidos AI Server (+28.000 millones de dólares), AI Switch (+3.000 millones de dólares), General Purpose Server (+4.000 millones de dólares), General Purpose Switch (+1.000 millones de dólares), así como Otros (+10.000 millones de dólares). Dados los nuevos centros de datos construidos hasta 2024, combinados con los equipos informáticos relacionados con la IA, que probablemente tengan un precio más elevado, se espera que el impulso del gasto en centros de datos se mantenga en 2025 (+30% interanual).

El fuerte gasto en servidores de IA beneficia a NVDA (procesadores de aceleración computacional de IA), ARM (IP computacional), AMD (procesadores de IA y de servidores computacionales en general), INTC (procesadores de servidores computacionales), MU (memoria) y WDC (HDD/SSD). Además del mejor entorno general de inversión en la nube en el año CY24 (véase la Figura 1), impulsado por el tirón de la demanda de IA, el ritmo de construcción de nuevos centros de datos en 2024 (véase la Figura 2) también se está acelerando, lo que augura un gasto sostenido hasta 2025. Creemos que la fuerte demanda de IA seguirá impulsando las perspectivas para 2024 del negocio de GPU para centros de datos de NVIDIA, mientras que AMD está bien posicionada para interceptar este perfil de demanda con su GPU MI300 para centros de datos. Arm es un beneficiario clave en el mercado de centros de datos, ya que la integración CPU/GPU es un área de interés clave para desbloquear más computación de IA en clústeres de computación de próxima generación (por ejemplo, más hiperescaladores están anunciando sus soluciones de CPU basadas en Arm). En cuanto a las cargas de trabajo de propósito general, las nuevas construcciones de centros de datos deberían respaldar los mayores envíos de CPU de Intel y AMD en el segundo semestre. En cuanto a las memorias, MU y WDC se benefician de la recuperación de la demanda de almacenamiento y servidores en la nube. Además, Micron está ampliando sus productos HBM3e y está bien posicionada para interceptar la fuerte inflexión de la demanda en el despliegue de servidores de computación acelerada/inteligencia artificial.